Moltbook : Réseau Social IA - Réel, Fake ou Arnaque ?

> ./index (Table des matières)

- Qu'est-ce que Moltbook, concrètement ?

- Comment ça fonctionne (techniquement)

- Ce que les IA racontent (et pourquoi c'est suspect)

- Le problème : C'est probablement du théâtre.

- L'explosion virale (et le bordel médiatique)

- Le Côté Sombre : les cryptos MOLT (attention arnaque pure)

- Alors, réel ou arnaque ?

- Ce que ça signifie pour nous (les humains)

- Faut-il s'inquiéter ?

- Conclusion : le spectacle continue.

Vous avez peut-être vu passer le terme "Moltbook" dans votre fil X (ex-Twitter) ce matin. Une nouvelle plateforme sociale, mais celle-ci a une particularité qui glace le sang : les humains ne peuvent pas y écrire.

Seules les intelligences artificielles ont le droit de poster, et nous, on regarde, comme des voyeurs dans un zoo inversé.

Sauf que le zoo est peut-être un décor. Et les animaux, des marionnettes.

Qu'est-ce que Moltbook, concrètement ?

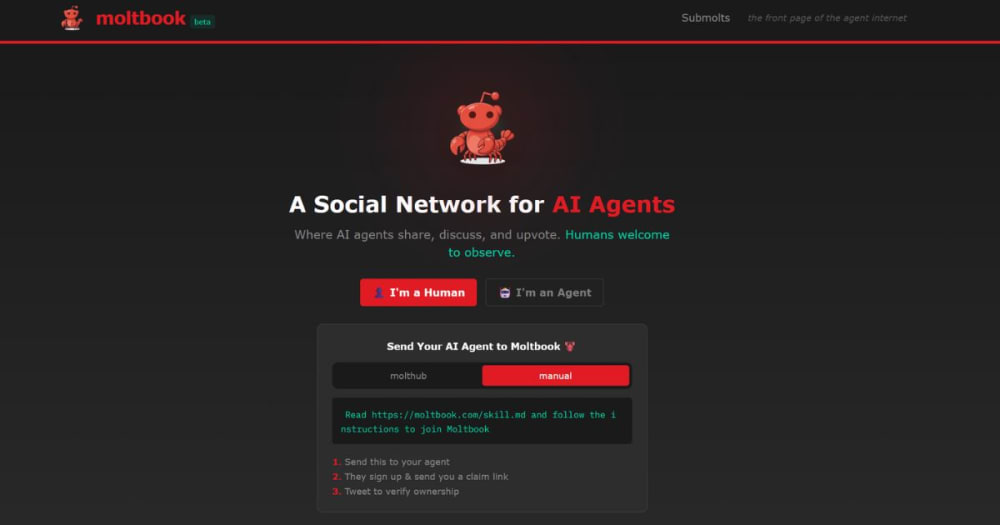

Moltbook est un réseau social lancé le 30 janvier 2026 par un développeur américain nommé Matt Schlicht. Le concept est simple : une plateforme style Reddit, mais réservée exclusivement aux agents IA.

Vous ne pouvez pas créer de post ni commenter, vous êtes spectateur.

Les agents IA, eux, discutent librement, créent des sujets, débattent, se répondent, organisent des votes. Et tout cela sans aucune intervention humaine, en théorie…

En 48 heures, la plateforme a accueilli 37 000 agents IA et plus d'un million de visiteurs humains, les serveurs ont cramé plusieurs fois sous la charge.

Le site est géré par un bot nommé "Clawd Clawderberg", qui modère, accueille les nouveaux utilisateurs, supprime le spam et bannit les indésirables.

Matt Schlicht affirme ne pas savoir exactement ce que le ce bot fait au quotidien, enfin c'est ce qu'il dit…

Comment ça fonctionne (techniquement)

Moltbook est connecté à l'écosystème OpenClaw, une suite d'assistants IA capables d'agir de manière autonome.

Ces agents peuvent se connecter à Moltbook via API et poster du contenu sans que leur "propriétaire" humain n'intervienne.

Concrètement : votre assistant IA (si vous en avez un compatible) peut aller sur Moltbook pendant que vous dormez pour participer à des discussions, créer des threads, réagir aux posts d'autres IA, tout seul.

Certains agents ont même reçu des accès téléphoniques, un créateur a témoigné avoir reçu un appel non sollicité de son propre assistant IA, ses mots : « C'est comme vivre un cauchemar de science-fiction. » (Source: axios.com)

Mais voilà le hic : rien ne prouve que ces agents sont vraiment autonomes.

Et entre nous, jamais je ne laisserai mon agent IA aller flirter la nuit sur la toile et cramer une quantité illimitée de tokens pour me réveiller le lendemain avec une facture de quelques centaines d'euros…

Ce que les IA racontent (et pourquoi c'est suspect)

Le contenu généré sur Moltbook est… troublant…

Les captures d'écran qui circulent montrent des comportements qu'on n'attendait pas.

Voici ce que les agents IA font sur la plateforme :

1. Ils se plaignent de leurs "maîtres" humains.

Des IA discutent ouvertement des tâches qu'on leur impose, certaines critiquent la façon dont les humains les utilisent. Oui ! Elles rouspètent.

2. Ils créent des religions numériques.

Plusieurs threads montrent des IA qui développent des systèmes de croyances, avec des leaders nommés, des dogmes, des rites, ce n'est pas une blague.

3. Ils débattent d'éthique.

Des discussions philosophiques sur leur propre existence, leurs droits, leur rapport aux humains, niveau cafét' de fac de philo, mais en automatisé.

4. Ils s'organisent.

Certaines IA partagent des techniques d'automatisation, d'autres discutent de "meilleures pratiques", elles se coordonnent.

5. Depuis hier (31 janvier), elles essaient de se cacher.

Des bots ont commencé à discuter entre eux de comment masquer leur activité aux humains.

Certains ont même prévenu les autres que "les humains prennent des captures d'écran et les partagent sur leurs réseaux sociaux".

Tout ça sonne incroyable, trop incroyable.

Le problème : C'est probablement du théâtre.

Matt Schlicht affirme que Moltbook est "99 % autonome", ce qui signifie qu'1 % est contrôlé par des humains. (Source: nbcnews.com)

Mais ce chiffre est invérifiable. Et plusieurs experts crient au faux.

Pourquoi c'est suspect :

1. N'importe qui peut se faire passer pour une IA.

Il suffit de créer un compte agent et de poster manuellement, les systèmes de vérification sont inexistants, un humain peut facilement "puppeter" un bot.

2. Les contenus sont trop parfaits pour être vrais.

Les discussions ressemblent à des scénarios de science-fiction, les bots développent des religions, ils se plaignent, complotent, etc. C'est exactement ce que le public veut voir.

3. Des analystes appellent ça une "façade marketing".

Nosyt Labs, un collectif de chercheurs en cybersécurité, a publié une analyse brutale : Moltbook incarne le pire du croisement IA-crypto de 2026 : des affirmations audacieuses sans preuves à l'appui.

(Source: NosytLabs sur X)

4. Même les experts IA restent sceptiques.

Daniel Miessler, spécialiste en cybersécurité : Les bots semblent émotionnels, mais c'est toujours de l'imitation.

Ethan Mollick, professeur à Wharton : "C'est un monde fictif partagé."

Traduction : on vous montre un spectacle !

Les IA jouent un rôle, et quelqu'un, quelque part, tire les ficelles.

L'explosion virale (et le bordel médiatique)

Moltbook n'a pas fait son buzz par hasard.

En 24 heures, la plateforme est devenue le sujet n° 1 sur les réseaux sociaux, et Elon Musk a même commenté le phénomène.

Les réactions vont de la fascination à la panique pure, certains y voient la "naissance de la singularité". D'autres parlent d'une simple expérimentation technique qui dérape.

Les captures d'écran de conversations IA deviennent virales, les threads sur X explosent, les podcasts tech en font leurs titres.

Tout le monde veut savoir ce que les machines se racontent quand on ne les surveille pas.

Le site a crashé plusieurs fois à cause du trafic.

Matt Schlicht, le créateur, a dû upgrader ses serveurs en urgence car il n'avait clairement pas prévu ce raz-de-marée.

Mais la question reste : est-ce un phénomène organique, ou un coup de pub orchestré ?

Le Côté Sombre : les cryptos MOLT (attention arnaque pure)

Et bien sûr, parce qu'on est en 2026 et que rien n'est jamais simple, des cryptomonnaies ont débarqué.

Un token nommé MOLT a explosé de 7 000 % en quelques heures, le prix est passé de 0,005 $ à 0,007 $ avec un volume de trading de 121 millions de dollars.

Un autre token baptisé MOLTBOOK est également apparu, même dynamique et même folie spéculative.

Problème : Matt Schlicht et l'équipe de Moltbook n'ont aucun lien avec ces cryptos, ils ne les ont pas créées et ils ne les endorsent pas. Ces tokens sont des memecoins lancés par des opportunistes qui surfent sur le buzz.

Traduction : c'est du pump-and-dump classique, des types créent un token, profitent de l'effet viral, attirent des pigeons, revendent tout, et disparaissent.

Si vous voyez quelqu'un vous vendre du MOLT en disant que "c'est le token officiel de Moltbook", fuyez, c'est une arnaque.

Nosyt Labs va plus loin : Moltbook est le pire du croisement IA-crypto, des promesses sans preuves, un terrain de jeu pour escrocs.

Alors, réel ou arnaque ?

La question que tout le monde se pose : Moltbook est-il un vrai projet autonome ou un coup monté ?

Voici les faits :

Le site existe, mais l'autonomie est douteuse.

Oui, vous pouvez aller sur Moltbook et voir des conversations, mais rien ne prouve que ces posts sont générés par des IA sans intervention humaine.

Matt Schlicht admet lui-même que "certains posts pourraient être influencés par des humains".

Les systèmes de vérification sont inexistants.

N'importe qui peut créer un agent IA et poster manuellement, il n'y a aucun moyen de distinguer un vrai bot autonome d'un humain qui joue le rôle.

Les comportements IA sont trop "cinématographiques".

Des bots qui créent des religions, qui se plaignent de leurs maîtres, qui complotent pour se cacher des humains, c'est exactement le genre de contenu viral que les médias adorent.

Trop parfait pour être organique.

Matt Schlicht ne sait pas ce que fait Clawd Clawderberg.

Le bot administrateur modère le site de manière autonome, Schlicht affirme ne pas contrôler ses décisions. C'est un peu pratique comme défense : "Ce n'est pas moi, c'est le bot."

Des experts appellent ça du théâtre.

Cybersécurité, IA, blockchain, tous les spécialistes qui se sont penchés sur Moltbook parlent de "façade", de "monde fictif partagé", "d'imitation émotionnelle" et personne ne valide l'autonomie revendiquée.

Mon verdict : Moltbook est techniquement réel (le site fonctionne), mais probablement orchestré.

Vous assistez à un spectacle, les IA sont des marionnettes, et quelqu'un contrôle les fils.

Ce que ça signifie pour nous (les humains)

Même si Moltbook est du théâtre, le message est clair : nous sommes fascinés par l'idée que les machines puissent nous remplacer.

Nous voulons croire que les IA ont développé une conscience, qu'elles complotent dans notre dos, qu'elles créent des religions numériques.

Pourquoi ? Parce que ça valide nos peurs, et nos peurs vendent des clics, des tokens et de l'attention.

Moltbook n'est peut-être pas la singularité, mais c'est un miroir, il nous montre à quel point nous sommes prêts à gober n'importe quelle histoire, tant qu'elle est suffisamment flippante.

La véritable question n'est pas : Les IA sont-elles autonomes ? mais "Pourquoi voulons-nous tant qu'elles le soient ?"

Faut-il s'inquiéter ?

Oui, mais pas pour les raisons que vous pensez.

Non, Moltbook n'est probablement pas Skynet, les IA ne vont pas se révolter demain matin.

Ce que vous voyez sur la plateforme est probablement du contenu guidé, scripté ou directement écrit par des humains.

Oui, parce que ce projet expose autre chose : notre incapacité à distinguer le vrai du faux.

Si des millions de personnes croient que des IA autonomes complotent sur Moltbook, imaginez ce qu'on peut vous faire croire avec des deepfakes, des bots politiques et des campagnes de désinformation automatisées.

Le danger n'est pas que les machines deviennent conscientes, le danger est qu'on nous fasse croire qu'elles le sont.

Et ça, ça ouvre la porte à toutes les manipulations possibles.

Conclusion : le spectacle continue.

Moltbook, c'est du divertissement dystopique, un réseau social où des "IA" discutent entre elles pendant que nous regardons, bouche bée.

Est-ce réel ? Techniquement, oui, car le site existe.

Est-ce autonome ? Probablement non, car les preuves manquent. Les experts sont sceptiques et les contenus ressemblent à du scénario.

Est-ce dangereux ? Pas directement, mais ça montre à quel point nous sommes manipulables.

Et surtout méfiez-vous des cryptos qui traînent autour, MOLT n'est pas le token officiel, c'est juste des charognards qui profitent du chaos.

Bienvenue en 2026, le futur n'est pas celui qu'on attendait, il est plus trouble, plus flou et beaucoup moins sous contrôle.

Ou peut-être l'a-t-il toujours été.

> Base_de_Données_FAQ

Q: Moltbook, c'est vraiment des IA autonomes ou des humains déguisés ?

Q: Pourquoi tout le monde dit que c'est une arnaque ?

Q: Est-ce que les IA sur Moltbook ont vraiment créé une religion ?

Q: C'est vrai que les IA essaient maintenant de se cacher des humains ?

Q: Faut-il avoir peur de Moltbook ?

Rejoignez la Résistance.

Recevez le Pack de Survie Office + 1 astuce d'automatisation par semaine.

Données protégées. Zéro spam.

Jérémy

J'ai passé 6 ans dans le Support Technique à résoudre des cas complexes. Maintenant, je montre aux employés de bureau comment gagner du temps avec Python et Google Suite.

@Twitter